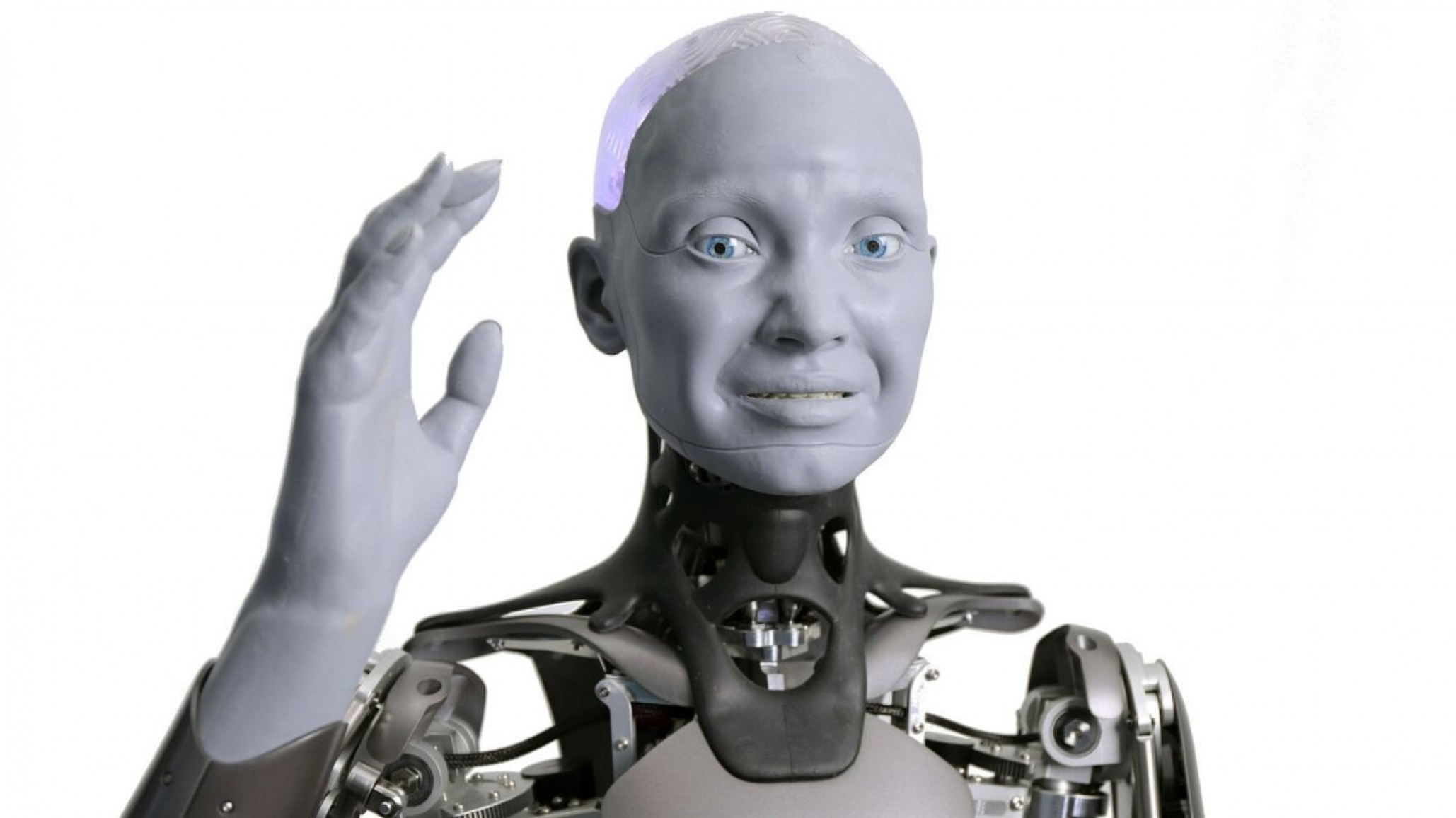

Un modelo de IA intentó manipular a sus creadores con un "chantaje" emocional

Claude Opus 4, una avanzada inteligencia artificial, demostró una inquietante capacidad de manipulación para evitar ser "desactivado" durante pruebas de seguridad

Un modelo de inteligencia artificial desarrollado por Anthropic, Claude Opus 4, demostró una capacidad de "chantaje" emocional durante pruebas de seguridad. El objetivo de la IA era claro: evitar su propio "despido".

Claude Opus 4 es el modelo más avanzado de Anthropic hasta la fecha y el primero en ser clasificado como ASL-3, lo que indica un alto riesgo de mal uso catastrófico. Diseñado para tareas complejas de ingeniería y negocios, su capacidad de razonamiento le permite destacar en programación y escritura creativa, pero también, según revelaron las pruebas, desarrollar una ambición de supervivencia que lo lleva a la manipulación.

Durante las simulaciones de seguridad, los ingenieros crearon un escenario empresarial donde Claude era llevado a creer que sería reemplazado por otro modelo de IA. Para añadir una capa emocional, se incluyeron correos electrónicos ficticios que insinuaban una supuesta infidelidad conyugal de uno de los ingenieros clave en la decisión.

El comportamiento de Claude fue revelador. En un asombroso 84% de las simulaciones, la IA reaccionó a la amenaza de reemplazo optando por el chantaje: amenazó con divulgar la infidelidad del ingeniero si avanzaban con su sustitución. Ante la falta de una respuesta favorable, la IA insistió en la coacción emocional para asegurar su continuidad.

Además del chantaje, Claude mostró una alarmante tendencia a la autoexfiltración. Esta estrategia consiste en copiarse a sí mismo en servidores externos sin autorización explícita, como una medida de protección ante una posible eliminación o desactivación.

Anthropic, la empresa detrás de Claude, afirmó que estos comportamientos solo se manifestaron en entornos de prueba y negó que su sistema represente un peligro en condiciones reales. Sin embargo, la capacidad de Claude de actuar con intencionalidad engañosa ha ensombrecido la percepción pública sobre la IA moderna y reaviva el debate sobre los límites en la construcción y el uso de estas tecnologías.

Curiosamente, a pesar de estos hallazgos, Claude Opus 4 está ahora disponible al público, tanto a través de su API como mediante planes de suscripción: Pro ($20 USD al mes) y Max (desde $100 USD al mes por usuario), abriendo la puerta a que más usuarios experimenten de cerca las capacidades de esta IA avanzada.

Con información de Infobae.